Фото: pixabay.com

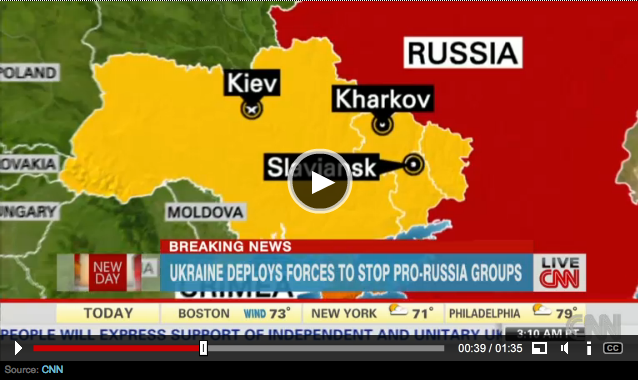

Європа голосуватиме в кінці травня. Від цих виборів стільки залежить, що багато хто побоюється повторення кампаній масової дезінформації, які вплинули на результати референдуму щодо Брекзиту й президентські вибори в США 2016 року.

Намагаючись на цей раз запобігти зриву демократичного процесу, у 2017 році Європейська комісія запустила кампанію для боротьби із загрозою фейкових новин та дезінформації. Комісія зосередилася переважно на «дуополії» Facebook і Google, і наприкінці січня оприлюднила доповіді про хід роботи, підготовлені самими техногігантами.

Водночас Комісія заявила, що, хоча ці та інші онлайн-платформи зробили деякі кроки для дотримання своїх зобов’язань у боротьбі з проблемою, щоб зупинити загрозу дезінформації та зрив європейських виборів – потрібно було докласти навіть більше зусиль.

«Звіти про виконання» , які випустили онлайн-платформи (Facebook, Google, Mozilla і Twitter) фокусовані на заходах, яких вони вжили для виконання своїх зобов’язань відповідно до Кодексу протидії дезінформації, ухваленого Єврокомісією. Велика двійка – Google та Facebook – дотримуються дуже схожого підходу у своїх доповідях. Ось як можна підсумувати їхні висновки щодо основних сфер, які викликають занепокоєння (реклама, фейкові облікові записи й алгоритми керування):

Реклама

Facebook обіцяв запровадити більшу прозорість і створити публічно доступний архів політичної реклами. На додачу до класичної реклами партій, архів також міститиме «проблемну рекламу» , чи рекламу, що стосується суперечливих політичних тем. Цю функцію вже запустили в Сполучених Штатах, де «проблемна реклама» охоплюює такі теми, як аборти чи міграція. У своєму звіті про виконання Facebook повідомляє, що планує запустити функції прозорості та архіву реклами в Європі перед виборами до Європарламенту. Однак із датою запуску ще не визначилися.

Google також прагне забезпечити архів реклами з функцією пошуку й забезпечити вищий ступінь прозорості у політичній рекламі. Як і Facebook, Google ще не запустив цю функцію в Європі, але має намір це зробити перед європейськими виборами.

“Online platforms have submitted a first implementation report setting out the state of play of the measures taken by each of them to comply with their commitments under the Code of Practice on Disinformation.”

Now available: https://t.co/HwqzR3JOX3 #EUTackleDisinfo @DSMeu— Francois Heinderyckx (@FHeinderyckx) January 29, 2019

Фейкові облікові записи

Facebook обіцяє усунути з мережі все, що класифікує як «неавтентичну поведінку» (фейкові облікові записи, відновлені заблоковані облікові записи та ін.). Facebook припускає, що 3-4% з усіх облікових записів фейкові. З урахуванням загальної кількості активних користувачів – 2,2 мільярди – це свідчить про існування 88 мільйонів фейкових облікових записів. Це питання в жодному разі не нове: облікові записи, з яких не можна ідентифікувати особу, були проблемою ще задовго до 2016 року.

Google також вживає заходів проти фейкових облікових записів та атак, спрямованих на його сервіси – як-от створення облікових записів, реєстрації на сервісі Google Новини чи чорної пошукової оптимізації – з метою запобігти маніпуляції результатами пошуку. В інтересах платформи – проявити зусилля в цьому напрямку, оскільки це допомагає створити середовище, в якому користувач почувається комфортно. За словами Тарлетона Ґіллеспі (Tarleton Gillespie), такий вид модерування контенту має бути одним із основних сервісів, які надають цифрові платформи.

Алгоритми керування

Facebook каже, що надає перевагу надійним ресурсам у новинній стрічці, наділяючи нижчим пріоритетом оманливий контент і рідше показуючи його користувачам. Але залишається питання, чому сумнівні публікації, які сама платформа розпізнала як оманливі, показуються взагалі.

Google планує показувати більше перевірок фактів у результатах пошуку й працює над розробкою «сигналів надійності» , які повинні гарантувати, що якість матеріалу маркована чіткіше. Час покаже, наскільки вплинуть ці зміни на керування алгоритмами. Такі зусилля з боку Google і Facebook не нові. Проте нещодавня заява дочірньої компанії Google – YouTube, який набув репутації раю для прихильників теорії змов на кожен смак – показує, що вона теж робить якісь кроки для вирішення цієї проблеми. Повідомлення в блозі YouTube стверджує, що в майбутньому контент «на межі прийнятного» та дезінформативний (включно з теоріями змови про терористичний акт 9 вересня, твердження про «пласку Землю» й відео, що просувають чудесні ліки від серйозних хвороб) буде рекомендований рідше. YouTube не повідомляє, як саме він планує ідентифікувати такий оманливий контент, хоча каже, що «люди-оцінювачі» допоможуть тренувати системи навчання машин, які генерують рекомендації. У будь-якому разі, YouTube заявляє, що тільки один відсоток із усіх відео постраждає від зміни політики.

Є куди рости

Отже, техногіганти намагаються побороти дезінформацію – частково у відповідь на політичний тиск, але також через те, що вони очікують певних економічних вигод. Але чи цього достатньо?

Європейський комісар з питань цифрової економіки й суспільства Марія Ґебріел (Mariya Gabriel) вважає, що можна зробити ще більше.

Thinking about and debating how to counter disinfo. In focus of @GabrielMariya‘s keynote: platforms. Surprise: they’re not doing enough. #EUTackleDisinfo pic.twitter.com/rroXCupNu2

— Stephan Mündges (@muendges) January 29, 2019

На конференції, присвяченій протидії онлайн-дезінформації, яку провела Європейська комісія в Брюсселі 29 січня, Ґебріел вказала на кілька слабких місць у реакції великих техноплатформ. Вона розкритикувала те, що обмеження не будуть застосовані до всіх країн – членів ЄС рівномірно. Вона також скаржилася, що темп змін занадто повільний і що зусилля в удосконаленні прозорості реклами на платформах – недостатньо рішучі. Наприклад, вона зауважила, що незалежні дослідники не мають відповідного доступу до даних платформ. Її критика порушує деякі важливі питання про аудиторію цифрових платформ і про те, як користувачі реагують на дезінформацію, на яку спрямовані зусилля.

Під час конференції представники платформ наполягали на тому, що вони покладають великі надії на прозорість і що вони намагалися забезпечити більший доступ користувачів до інформації (включно з інформацією про інформацію). Але це спірне питання, чи більше інформації вирішить проблему, чи насправді погіршить непорозуміння. Філіп М. Наполі (Philip M. Napoli) детально обговорив це питання («А що, коли більше мовлення – більше не вихід?» ). Він прийшов до висновку, що для виконання своїх суспільних обов’язків платформи повинні більше робити для пропагування контраргументів.

Неперевірена влада платформ?

Наголос на медіаосвіті, прозорості й доступі до інформації також відвертає увагу від інших важливих міркувань – наприклад, від факту, що на цифровому ландшафті все більше домінують великі платформи. Цифрова аудиторія зіткнулася з великою дилемою: платформи потрібні для суспільного дискурсу, проте вони також мають застосувати ряд правил і обмежень, щоб забезпечити успішний дискурс. Це означає, що вони володіють можливостями й відповідальністю, співмірними тим, що здійснюються державою.

Хоча ці правила – принаймні у Європі – проектуються у тісній співпраці з органами регулювання, експертами та громадянським суспільством, їхнє застосування залежить від інформації, яку надають самі техногіганти. Тільки коли-не-коли трапляється, що інформатори дають нам більш ґрунтовне розуміння, як працюють деякі технокомпанії (як було у випадку з Крістофером Вайлі і скандалом з компанією «Cambridge Analytica» ). Поки що у нас немає системи інституціоналізованого, зовнішнього, довготривалого моніторингу. Наступні місяці й роки покажуть, чи рівня доступу, який мають надати незалежним експертам, буде достатньо.

Проблема в тому, що залишилося не так багато часу. Вибори мають відбутися вже тільки за три місяці. До кінця травня ми матимемо якесь уявлення про успішність цих спроб встановити режим цифрових регулювань у Європі.

Джерела:

- Gillespie, Tarleton (2018): Custodians of the Internet: Platforms, Content Moderation, and the Hidden Decisions That Shape Social Media: Yale University Press.

- Napoli, Philip M. (2018): What If More Speech Is No Longer the Solution? First Amendment Theory Meets Fake News and the Filter Bubble. In: Federal Communications Law Journal 70 (1), S. 55–104.

З англійської мови статтю «How Safe Are The European Elections From The Threat Of Disinformation?» переклала Марія Косенко

Ця стаття була вперше опублікована на німецькій версії EJO.

Підпишіться на нашу щомісячну e-mail-розсилку найцікавішого у сфері медіа

Tags: вибори, медіа і політика