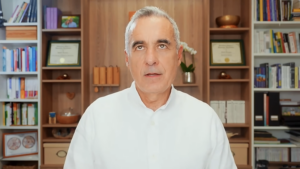

24 листопада 2024 року в першому турі президентських виборів у Румунії 23 зі 100 виборців, які взяли участь у голосуванні, підтримали кандидата, який не мав ні політичної партії, ні передвиборчого штабу, ні задекларованого бюджету, а також практично не був представлений у провідних медіа. Цей результат став справжньою сенсацією. Понад два мільйони громадян проголосували за Келіна Джорджеску — кандидата, який за звичайних обставин не мав би реальних шансів на успіх. Після виборів медіа описували його як «персонажа з TikTok», який транслював свою передвиборчу кампанію прямо зі своєї вітальні. Джорджеску не мав традиційного штабу, а спілкування з пресою відбувалося просто на вулицях села Ізворані, неподалік від Бухареста, столиці Румунії.

24 листопада 2024 року в першому турі президентських виборів у Румунії 23 зі 100 виборців, які взяли участь у голосуванні, підтримали кандидата, який не мав ні політичної партії, ні передвиборчого штабу, ні задекларованого бюджету, а також практично не був представлений у провідних медіа. Цей результат став справжньою сенсацією. Понад два мільйони громадян проголосували за Келіна Джорджеску — кандидата, який за звичайних обставин не мав би реальних шансів на успіх. Після виборів медіа описували його як «персонажа з TikTok», який транслював свою передвиборчу кампанію прямо зі своєї вітальні. Джорджеску не мав традиційного штабу, а спілкування з пресою відбувалося просто на вулицях села Ізворані, неподалік від Бухареста, столиці Румунії.

Наступних чотирьох кандидатів у президенти підтримали чотири основні парламентські партії, які разом задекларували виборчі витрати у розмірі майже 19,5 мільйонів євро. Серед них: прем’єр-міністр Румунії, який посів третє місце, та голова Сенату і колишній прем’єр, який опинився на п’ятому місці.

Через два дні після голосування генерального директора TikTok викликали до Європейського парламенту, щоб пояснити роль платформи у результатах румунських виборів.

Ще через два дні Вища рада національної оборони (CSAT) на вимогу президента Румунії Клауса Йоханніса провела екстрене засідання. У своїй заяві CSAT попередила про «можливі ризики для національної безпеки», пов’язані з діями кіберсуб’єктів державного та недержавного рівня. TikTok було звинувачено у преференційному ставленні до Келіна Джорджеску та порушенні румунського виборчого законодавства.

Через тиждень після виборів частину документів, представлених Вищою радою національної оборони (CSAT), було розсекречено. Вони доповнили результати розслідувань журналістів та громадських активістів, які викрили скоординовану кампанію у кількох соціальних мережах на підтримку Келіна Джорджеску. Також було виявлено його зв’язки з неонацистськими групами.

Дискурс Келіна Джорджеску, поширюваний у соціальних мережах та відеоплатформах, був детально проаналізований медіа та активістами. В ньому було ідентифіковано проросійські, антинатовські та антиєвропейські меседжі, які перепліталися з численними посиланнями на релігійність, псевдонаукові теорії та сувереністський підхід до сільського господарства й економіки. Після першого туру президентських виборів ситуація на ринках різко погіршилася: протягом двох тижнів Бухарестська фондова біржа перебувала у стані «вільного падіння», за даними видання Ziarul Financiar.

У п’ятницю, 6 грудня, через кілька годин після початку голосування в другому турі президентських виборів для румунської діаспори, Конституційний суд Румунії скасував увесь виборчий процес. Суд зобов’язав уряд перенести вибори на пізніший термін. Рішення було ухвалено на основі документа Венеціанської комісії, оприлюдненого того ж дня. Документ під назвою «Роз’яснювальна декларація Кодексу належної практики у виборчих справах щодо цифрових технологій та штучного інтелекту» вказує на:

необхідність вирішення проблеми організованих дезінформаційних кампаній, які можуть підривати цілісність виборчих процесів.

Як правий кандидат, який здебільшого вів свою кампанію в інтернеті, зміг здобути значну частину голосів у першому турі президентських виборів у Румунії? Чи став він бенефіціаром добре скоординованої кампанії інформаційного хаосу? Якщо в ситуації винен TikTok, то який саме механізм дозволив онлайн-кандидату досягти успіху в реальних, офлайн-виборах? І головне – як можна запобігти подібним дезінформаційним кампаніям, які здатні суттєво вплинути на результати виборів?

Ось те, що ми знаємо.

Соціальні платформи у виборчій кампанії

Келін Джорджеску був особливо помітний на TikTok, а також активно згадувався на Facebook та YouTube. Протягом кількох років інформація про нього поширювалася через WhatsApp, часто супроводжуючись посиланнями на YouTube та публікаціями в альтернативних медіа. Одне з таких відео, опубліковане ще у 2021 році, було спростоване провідними новинними редакціями.

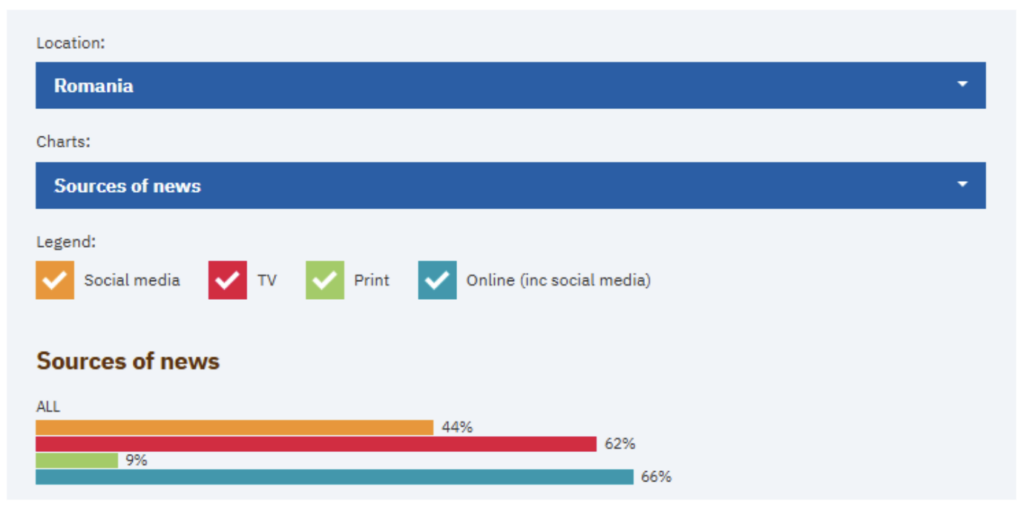

З 2020 року соціальні платформи стали головним джерелом інформації для цифрової аудиторії, поступово витісняючи мейнстримні медіа, як це демонструє Digital News Report (DNR). Це багаторічне міжнародне дослідження, координоване Інститутом Reuters при Оксфордському університеті, охоплює понад 40 медіаринків, включно з Румунією. Згідно з даними DNR за січень-лютий 2024 року, найбільш популярними соціальними платформами серед румунської аудиторії були: Facebook (64%), YouTube (56%), WhatsApp (56%), Facebook Messenger (54%), TikTok (31%) та Instagram (27%).

У соціальних мережах аудиторія не шукає новини активно — це новини знаходять свою аудиторію. Інформація та думки про суспільні події з’являються у нашій стрічці, якщо алгоритми соціальних платформ вирішують, що певний контент є для нас релевантним. Це відбувається поряд із публікаціями про котиків, собачок, їжу, ролики про макіяж, фотографії з друзями та, звісно ж, рекламою. Попри цей добре відомий недолік, майже половина респондентів у румунській вибірці зазначила, що використовує соціальні мережі для отримання новин. При цьому шестеро з десяти вказали телебачення як ще одне важливе джерело інформації.

Дані Звіту про цифрові новини за 2024 рік свідчать, що майже половина румунської цифрової аудиторії використовує соціальні мережі як джерело новин [джерело].

Facebook, YouTube, TikTok та Instagram в Європейському Союзі класифікуються як дуже великі онлайн-платформи (VLOP) і зобов’язані дотримуватися вимог Закону про цифрові послуги (DSA). Цей закон, що набув чинності у 2024 році, спрямований на «створення більш безпечного цифрового середовища, яке забезпечує захист основних прав користувачів». До цих прав входить доступ до коректної інформації та можливість ознайомитися з усіма точками зору під час виборів. Натомість дві інші популярні в Румунії платформи — WhatsApp та Facebook Messenger, які належать Meta, — є піринговими мережами, що працюють у закритому форматі. Вони не підпадають під дію DSA та недоступні для моніторингу з боку державних органів чи академічних установ.

Послання для незадоволених

У своїх інтерв’ю на YouTube та в соціальних мережах Келін Джорджеску використовував як старі теорії змови (від фальшивої висадки на Місяць до 5G), так і нові дезінформаційні наративи. Наприклад, він стверджував, що вода — це не просто H2O. За його власним резюме, Джорджеску є експертом із забруднення, а також має ступінь доктора філософії в галузі педології (1999). Наразі він працює в державному румунському університеті.

Теорії змови, які поширював Джорджеску, були змішані з націоналістичними та містичними меседжами, а також із закликами до антинатовських та антиєвропейських поглядів. В інтернеті циркулюють списки з понад 430 спірними твердженнями, пов’язаними з його публічними висловлюваннями. Існує навіть вебсайт під назвою «Що сказав Келін» (What Călin Said), який збирає і пов’язує ці суперечливі твердження з їхніми джерелами.

Factual, найвідоміша румунська команда з перевірки фактів, перевірила 32 заяви Келіна Джорджеску — від наночіпів у газованих напоях до смерті від хіміотерапії — і визнала лише одну з них частково правдивою. Це стало найбільш масштабною спробою фактчекінгу суперечливих тверджень Джорджеску.

З точки зору дослідника, використання Джорджеску містичного, сувереністського дискурсу, змішаного з наративами теорій змови, має важливе значення, оскільки дослідження показують, що теорії змови частіше зустрічаються серед крайніх лівих та правих політичних груп. «Цей нелінійний зв’язок може посилюватися в умовах політичного контролю, але не зводиться лише до нього», — пояснюють Імхофф і його колеги в науковій статті, опублікованій у 2022 році.

Тож чи проголосував за Джорджеску електорат, схильний до крайніх правих поглядів?

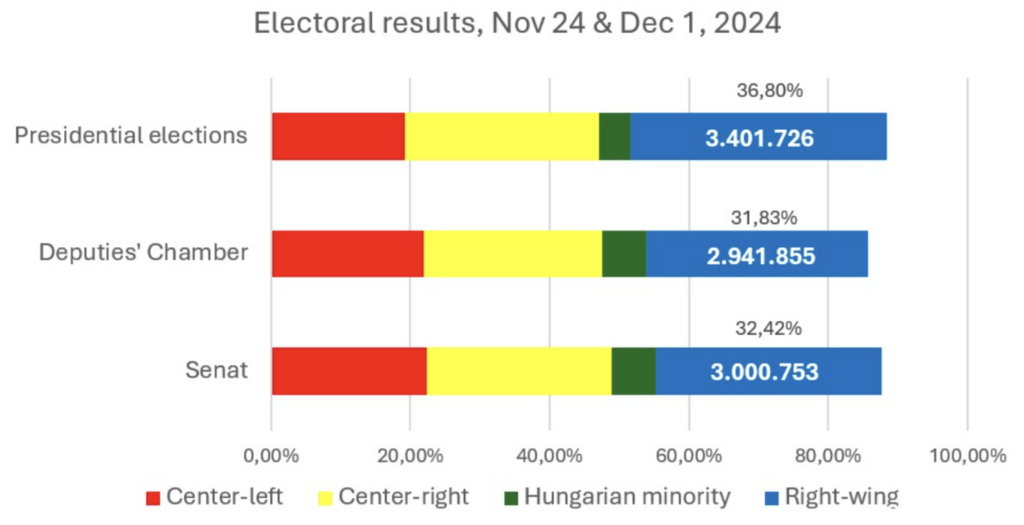

Ми зібрали дані про відсотки голосів, отриманих Келіном Джорджеску та Джорджею Сіміоном, лідером правої парламентської партії Альянс за союз румунів (AUR), у період між 2020 і 2024 роками. Ці два кандидати набрали майже 37% голосів від 3,4 мільйона виборців на президентських виборах 24 листопада.

Якщо додати відсоток, отриманий трьома правими партіями, які подолали виборчий бар’єр на парламентських виборах через тиждень, ми отримуємо подібні результати. AUR, SOS Румунія і Партія молоді (POT) разом набрали близько 32% голосів від 3 мільйонів громадян на виборах до обох палат румунського парламенту.

Радикально налаштовані невдоволені виборці під час виборів у листопаді-грудні 2024 року в Румунії. На парламентських виборах до нового румунського парламенту пройшли 3 мільйони виборців, які віддали свої голоси за праві партії з майже 9,5 мільйона виборців, що взяли участь у голосуванні. Джерело: дані Постійного виборчого органу, наші власні розрахунки.

SOS і POT — це партії, засновані колишніми членами Альянсу за союз румунів (АЄР). Джорджеску також мав попередні зв’язки з АЄР. Члени АЄР, зокрема, підтримували Келіна Джорджеску як потенційного почесного президента партії та майбутнього прем’єр-міністра Румунії.

На останніх виборах 2020 року за праві партії проголосувало близько півмільйона осіб. Чотири роки по тому 3,5 мільйона виборців обрали правого кандидата, а 3 мільйони проголосували за праву партію. У 2024 році кількість виборців зросла майже вдвічі порівняно з 2020 роком: на парламентських виборах проголосувало 9,4 мільйона осіб, тоді як у 2020 році це число складало 5,9 мільйона.

Кампанія, заснована на мікроінфлюенсерах

З червня 2024 року Келін Джорджеску став бенефіціаром кампанії, орієнтованої на «скоординоване поширення інформації на кількох платформах». Це скоординоване поширення є частиною стратегії, яка передбачає систематичне донесення однієї й тієї ж інформації до цільової аудиторії протягом певного періоду часу. Згідно з розсекреченими матеріалами Румунської розвідувальної служби, інтенсивність кампанії помітно зросла за два тижні до дня голосування.

Серед платформ, що використовувалися для просування кандидатури Джорджеску, були TikTok, де політична комунікація позиціонувалася як розвага, інформація та освіта, а також Facebook, YouTube, Instagram, WhatsApp і Telegram. Ці факти були підтверджені громадською організацією «Експертний форум» і журналістською редакцією G4Media, що спеціалізується на розслідуваннях.

У межах цієї кампанії активно використовувалися інфлюенсери, які координували свої дії через платформи, такі як FameUp (платформа для зв’язку між брендами та інфлюенсерами) та закрита соціальна мережа Telegram.

Журналісти-розслідувачі виявили, що в одному з Telegram-груп, створених для просування кандидатури Келіна Джорджеску, було надіслано понад 1800 фотографій і відео. Ці матеріали мали бути відредаговані для того, щоб алгоритми платформ вважали їх новим контентом, після чого вони повинні були бути репостовані в органічно сформованих середовищах, щоб алгоритми сприяли їх подальшому поширенню. Як встановили журналісти G4Media, учасники цієї діяльності отримували оплату на конкурсній основі.

На платформі FameUp інфлюенсери отримали сценарії від двох організацій, які не були офіційно зареєстрованими комерційними компаніями в Румунії. Назви цих компаній виявилися вигаданими. Сценарії адаптували меседжі Келіна Джорджеску, не згадуючи його ім’я, та просували хештег «Рівновага і вертикальність». Водночас, у коментарях багато людей виявляли труднощі з тим, щоб визначити, кого саме підтримують ці інфлюенсери, як зафіксували журналісти HotNews.

Міністерство внутрішніх справ зазначило, що кампанія «Рівновага і вертикальність» використовувала ті ж методи маніпуляцій, що й кампанія «Брат за брата», проведена Росією в Україні. «Обидві кампанії базуються на маніпулюванні легітимними мікроінфлюенсерами», — підкреслює відомство.

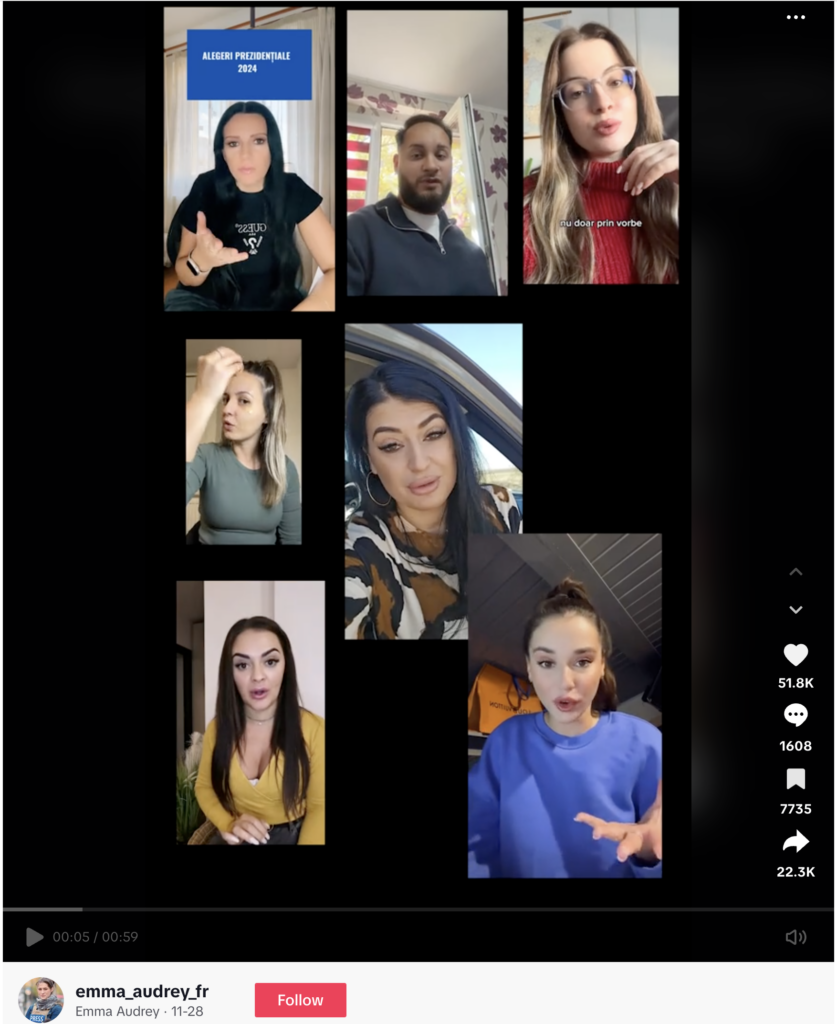

Вибірка мікроінфлюенсерів, що демонструють сцени за кермом автомобіля або під час нанесення макіяжу, поки читають сценарії про президентські вибори, був опублікований на платформі FameUp під хештегом «Рівновага і вертикальність».

Дослідники вже давно намагаються з’ясувати, як медіа впливають на процес прийняття рішень і на те, як люди обирають, за кого голосувати. Пол Лазарсфельд та його команда виявили в 1950-х роках, що люди обізнані про медіаповідомлення, але те, що ці повідомлення означають для них і як вони впливають на їхній вибір, залежить від роботи лідерів громадської думки в межах спільнот.

Під час виборчих кампаній медіа визначають, які питання є ключовими на порядку денному суспільства, відповідно до теорії формування порядку [англ. agenda setting theory] денного МакКомбса і Шоу, сформульованої у 1972 році. Однак медіа не завжди вказують, як саме позиціонувати себе стосовно цих питань.

Сучасні дослідження також показують, що медіаперсонажі можуть мати значний вплив на ставлення та поведінку людей у короткостроковій перспективі. В результаті в комунікаційних студіях було введено концепцію «парасоціальних лідерів думок», яка пояснює цей феномен.

Парасоціальним лідером думок може бути будь-який медіаперсонаж, з яким ми не маємо реальної взаємодії, але який здається нам знайомим або близьким. Це може бути політик, який виглядає емоційно відвертим, плачучи або показуючи своє особисте життя через сім’ю чи будинок; реальна людина, що тролить журналіста в соціальних мережах, розповідаючи про свої емоції в перебільшеній формі; персонаж із серіалу, чия життя відображає наше власне або те, яким ми б хотіли його бачити; або навіть бот з фото милого котика на пляжі, який пише: «Я голосую за Джорджеску». Це можуть бути будь-які медіаперсонажі, які здаються нам схожими на нас самих.

Румунські інфлюенсери TikTok, які брали участь у кампанії Джорджеску, здобули популярність завдяки своїм захопленням макіяжем, автомобілями, модою та розвагами, пояснює «Експертний форум». Вони постали в мережі як звичайні люди, що займаються повсякденними справами. Вони говорять про ідеального кандидата в президенти, поки прасують одяг або наносять макіяж, а також можуть з’являтися за кермом автомобіля чи на кухні. Це звичайні люди, які, як і ми, готуються до дня голосування. Ми насправді не знаємо їх, але відчуваємо, що вони наші друзі. Саме так виникають парасоціальні стосунки, які ми розвиваємо з цими медіаперсонажами.

Чи можуть парасоціальні лідери думок впливати на виборчі рішення так само, як вони впливають на наш стиль одягу чи зачіску? Ймовірно, так — для деяких людей, за певних умов і з певними меседжами.

Усі кандидати на пост президента були присутні в соціальних мережах, і кілька партій використовували тролів та ботів під час виборчої кампанії. Однією з причин, що зробила кампанію за Келіна Джорджеску настільки ефективною, було те, що він отримував переважно позитивне висвітлення у порівнянні зі своїми політичними суперниками, зазначає «Експертний форум». Його опоненти не атакували Джорджеску, оскільки не вважали його серйозною загрозою, поки не стало занадто пізно — його виборці вже були налаштовані радикально.

Хто стоїть за кампанією Джорджеску?

28 листопада Вища рада національної оборони зробила заяву про можливе втручання «державних і недержавних кіберсуб’єктів», що могло вплинути на виборчий процес у Румунії. Однак, через два тижні журналісти вказали, що жоден орган влади не надав доказів іноземного впливу на вибори.

Журналісти-розслідувачі та громадські активісти з Румунії, Болгарії та Франції виявили можливі зв’язки між рекламними кампаніями в Східній Європі та Росією. Експерти, які досліджували виборчу кампанію Келіна Джорджеску, повідомили журналістам, що для просування його кандидатури були залучені мережі, пов’язані з Росією та іншими країнами, що спеціалізуються на дестабілізації демократії. Наразі румунські правоохоронці розслідують джерела фінансування онлайн-кампанії на підтримку Джорджеску. Один з донорів був ідентифікований як румунський криптовалютний інвестор, який стверджував, що надавав гроші для підтримки промоутерів кількох кандидатів, а не лише Джорджеску. Платформа FameUp також перебуває під слідством. Згідно з даними журналістів Snoop, фіскальні органи виявили, що Націонал-ліберальна партія (НЛП) заплатила за кампанію в TikTok під назвою «Рівновага і вертикаль», яка просувала Джорджеску. Комунікаційна компанія, що працює на НЛП, визнала факт платежів і звернулася з проханням про офіційне розслідування, щоб перевірити, чи не була її кампанія «клонована або викрадена». У 2021 році Націонал-ліберальна партія сформувала правлячу коаліцію з Соціал-демократичною партією. Клаус Йоганніс, чинний президент Румунії, є колишнім членом НЛП.

Перед першим туром виборів румунські виборчі органи звернули увагу на незаконне просування Келіна Джорджеску, зокрема на відсутність обов’язкової позначки, що рекламні матеріали є частиною виборчої кампанії. Влада звернулася до Facebook (підконтрольна Meta) та TikTok (підконтрольна ByteDance) з вимогою припинити розміщення цих матеріалів, однак TikTok не відреагував.

Після виборів TikTok відмовився брати на себе будь-яку відповідальність за події, що стосуються президентських виборів у Румунії, заявивши, що вони не дозволяють політичну рекламу й ретельно відслідковують діяльність, яка може вводити в оману. Однак журналісти-розслідувачі з Recorder та Snoop виявили, що TikTok, ймовірно, має уразливість у своїй системі безпеки, яка дозволяє легко створювати фальшиві акаунти та використовувати ботів для швидкого збільшення популярності (фальшивих) кандидатів — до 1 мільйона переглядів менш ніж за дві години.

Ці викриття додають складності до дискусії щодо можливих впливів на виборчі процеси.

Ми звикли пов’язувати соціальні платформи з ринковою економікою, а алгоритми — з прагненням до прибутку. Однак медіапродукти не завжди створюються та поширюються з метою заробітку. Наприклад, новинні редакції можуть працювати на користь широкої громадськості, бути частиною комерційного підприємства, яке має на меті отримання прибутку, але також можуть використовуватися для політичних чи економічних цілей, зокрема для пропаганди. Можливо, настав час застосувати подібний підхід і до соціальних мереж, а не тільки до традиційних медіа. Якщо держави володіють і контролюють традиційні медіа для впливу на громадську думку, чи будуть вони утримуватися від контролю та володіння соціальними платформами?

Алгоритми можуть використовуватися для просування або обмеження різних точок зору, осіб, ідей та наративів — як для впливу, так і з метою отримання прибутку. Вірусність контенту може бути оплачена зацікавленими сторонами.

Журналісти-розслідувачі та цифрові активісти продемонстрували після виборів у Румунії, що з належними ресурсами алгоритми соціальних платформ можна маніпулювати, щоб націлити конкретну аудиторію на мікс повідомлень, які в кінцевому підсумку впливають на реалізацію вільного виборчого права в країні.

Влада повинна нести відповідальність за виявлення тих, хто маніпулює виборчими процесами в Інтернеті, та вжити заходів для запобігання таких інцидентів у майбутньому.

Уроки, отримані під час президентських виборів у Румунії 2024 року

Тепер, коли виборчий процес у Румунії завершено, ми можемо зробити кілька важливих висновків:

- Журналісти та громадські активісти не в змозі швидко спростувати всі неправдиві повідомлення, що поширюються лавиноподібно під час скоординованих кампаній. Однак вони можуть перевіряти факти стосовно основних тверджень, попереджати про небезпечні джерела дезінформації та звертати увагу на інформацію, яка набирає вірусної популярності. Раннє виявлення і попередження може бути надзвичайно корисним, як показує інокуляційна теорія впливу медіа.

- Теорії змови та неправдива інформація можуть бути складовими частинами скоординованої кампанії, яка набуває вірусності на різних платформах. Кампанія Келіна Джорджеску не обмежувалася лише TikTok. Його постійно висвітлювали традиційні медіа завдяки його зв’язкам з правою партією та відео в соціальних мережах. Посилання на інтерв’ю Джорджеску на YouTube циркулюють у WhatsApp вже багато років. Хоча його можуть сприймати як кандидата від TikTok, це здебільшого через те, що платформа відмовилася видалити його рекламні матеріали за три дні до виборів. Кампанія Джорджеску в TikTok була основною, доступною для громадського контролю, але TikTok – не єдина платформа, яку він використовував. Громадські активісти та журналісти продемонстрували, що Джорджеску був присутній не тільки в TikTok, а й на Facebook, YouTube, Instagram, WhatsApp і Telegram.

- Парасоціальні лідери думок можуть бути залучені до виборчих кампаній для поширення вже існуючого передвиборчого контенту. До таких лідерів належать мікровпливові особи, тролі, боти, а також політичні лідери та звичайні користувачі соціальних мереж, які активно підтримують певну ідею, кандидата, політичну платформу або справу, роблячи це в надмірний, але зрозумілий для інших користувачів спосіб.

- Політичний контент може з’являтися в постах, відео, коментарях, (нативній) рекламі — у всіх типах матеріалів, що поширюються через соціальні платформи. Те, що соціальна платформа заявляє про розважальний характер всього контенту, або те, що мікроінфлюенсер відомий своїм контентом про косметику та автомобілі, не означає, що платформа ніколи не буде поширювати політичний контент чи що інфлюенсер не ділитиметься політичними рекомендаціями за рекламну винагороду.

Попередні дослідження ехо-камер, парасоціальних лідерів думок та теорії щеплення (див. Radu, 2023) вказують на те, що вірусний контент, створюваний парасоціальними лідерами думок, ґрунтується на стратегіях радикалізації та надмірної публічної поведінки.

Стратегії, які спонукають людей до вибору тієї чи іншої сторони у суспільних питаннях, включають ідентифікацію ворога, визначення загрози, спростування альтернативних комунікаційних рамок і підтвердження приналежності до внутрішньої групи. Усі ці стратегії часто використовуються під час виборчих кампаній для впливу на поведінку виборців, але кампанія Джорджеску виявилася значно успішнішою, ніж зазвичай.

Однією з причин успіху кампанії Джорджеску може бути використання парасоціальних лідерів громадської думки, які демонстрували надмірну публічну поведінку, що робила їх більш доступними та людяними для незадоволеного електорату. Така поведінка включала образливу лексику, сильні негативні емоції, спрямовані проти політичних опонентів Джорджеску, а також демонстрацію трансгресивного інтимного «я». Боти, тролі та мікроінфлюенсери публічно обговорювали особисті вибори, які часто залишались таємними: за кого вони мають намір голосувати і чому. Для того, щоб виглядати більш близькими, деякі з них влаштували виставку приватних моментів: розповідали про свої стосунки з Богом, як прасують тканину, якою є їхня кухня, або як наносять макіяж.

Безумовно, кожен має право ділитися інформацією про своє приватне життя в Інтернеті, якщо це не порушує закон. Однак кампанія Джорджеску була фактично незаконною в Румунії, оскільки громадяни, які отримували його повідомлення, не були належно попереджені, що вони піддаються впливу оплачуваного контенту.

Цілком можливо, що штучний інтелект (ШІ) може бути навчений відстежувати ключові терміни, такі як назви партій, імена політичних кандидатів, а також суспільні питання, такі як мир, війна, Україна чи Палестина, які, ймовірно, набувають вірусності в одному географічному регіоні на кількох платформах одночасно.

Журналістам і громадським активістам може бути корисною платформа, яка дозволяє побачити, що саме спостерігає громадськість у різних соціальних мережах на певній географічній території в конкретний момент часу, забезпечуючи прозорість, подібно до того, як це робить Google через Google Trends.

Крім того, штучний інтелект (ШІ) може бути використаний для діагностики середовища, в якому виникають ключові терміни. Наприклад, якщо певні терміни стають вірусними завдяки парасоціальним лідерам думок, що є частиною можливої дезінформаційної кампанії, спрямованої на радикалізацію.

Таким чином, журналісти, громадські активісти, органи влади та широка громадськість можуть отримати своєчасне попередження про потенційні «кампанії інформаційного безладу», які можуть підірвати цілісність виборчих процесів (як зазначено у висновках Венеціанської комісії) або будь-якої іншої публічної дискусії щодо ключових питань, що становлять суспільний інтерес.

Цей текст було вперше опубліковано на сайті ENO/PROMPT 17 грудня 2024 року. Автори: Ралука Раду, ADB Romania та Бухарестський університет. Українською переклала Олександра Ярошенко.

Погляди, висловлені на цьому сайті належать авторам і не обов’язково відображають точки зору, політики та позиції EJO.

Стежте за нами у Facebook.

Tags: Facebook, Instagram, PROMPT, TikTok, YouTube, вибори, медіа і вибори, президентські вибори, розслідування, Румунія, соціальні медіа і політики, соцільні мережі, соцмережі, фактчекінг